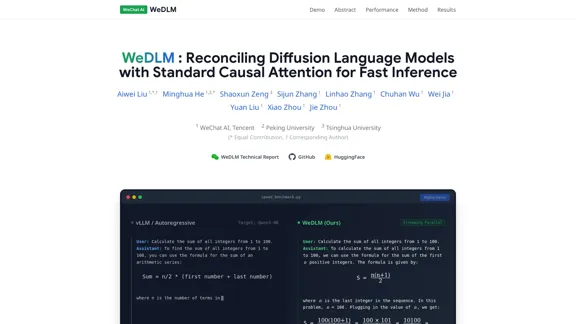

WeDLM 是一個尖端框架,將擴散語言模型 (DLLMs) 與標準因果注意機制相結合,以實現快速推理。它通過實現並行解碼來解決傳統自回歸生成的限制,同時保持高質量的輸出。該框架旨在提高語言模型的效率,使其適用於各種應用,包括數學推理和代碼生成。

WeDLM - 將擴散語言模型與標準因果注意力相結合,以實現快速推理

WeDLM 介紹

WeDLM 功能

-

因果擴散框架

WeDLM 利用完全基於因果注意的擴散解碼框架。這一設計允許從預訓練的自回歸檢查點無縫初始化,並確保與前綴緩存的兼容性。

-

前綴緩存兼容性

模型預測的標記可以立即緩存,允許在不等待後續位置的情況下高效重用上下文。這一特性提高了推理的速度。

-

流式並行解碼

WeDLM 引入了一個動態滑動窗口進行解碼,消除了典型的區塊方法中的停止和等待行為。這種方法保持了高 GPU 利用率,加快了生成過程。

-

性能改進

WeDLM 在複雜推理任務中實現了顯著的加速,報告顯示在低熵生成場景中速度提升可達 10 倍,同時保持與優化的自回歸引擎相比的輸出質量。

-

整體能力

該框架在各種基準測試中匹配或超越現有模型的能力,包括數學、編碼和一般知識任務。

WeDLM 如何使用?

- 通過查看 WeDLM 的技術報告來熟悉該框架,以全面了解其方法論。

- 在不同任務上實驗該模型,以評估其在各種基準測試中的性能。

- 有效利用緩存功能以提高應用程序的速度。

- 探索動態滑動窗口方法以優化推理過程。

WeDLM 常見問題

WeDLM 是什麼?

WeDLM 是一個擴散解碼框架,整合了標準因果注意機制,以提高語言模型推理的速度和效率。

WeDLM 如何實現更快的推理?

通過採用因果注意和流式並行解碼策略,WeDLM 允許同時生成標記,顯著減少與傳統自回歸模型相比的延遲。

使用 WeDLM 的主要優勢是什麼?

WeDLM 提供了更快的速度、前綴緩存兼容性,並在各種任務中保持高質量的輸出,使其成為語言模型應用的多功能工具。

WeDLM 與其他語言模型相比如何?

WeDLM 在速度上超越了優化的自回歸引擎,同時保持生成內容的質量,特別是在複雜推理和低熵任務中。

WeDLM 價格

價格數據尚不可用,請訪問官方網站查詢。

WeDLM 評價

- WeDLM 在生成高質量輸出方面展現了令人印象深刻的能力,同時顯著減少了推理時間,成為開發者和研究人員的寶貴工具。

- 將因果注意與擴散模型相結合是一項顯著的創新,提升了性能和效率。

- 然而,該模型的複雜性可能要求用戶對擴散過程和因果注意機制有扎實的理解,以充分利用其能力。

- 總體而言,WeDLM 代表了語言模型技術的一項重大進步,但進一步的用戶友好文檔和教程可以提高新手的可及性。

WeDLM 最新流量資訊

月訪問量

跳出率

每次訪問瀏覽頁數

訪問時長(s)

全球排名

國家排名

最近訪問量

流量來源

- 社群媒體0.0%

- 付費推薦0.0%

- 郵件0.0%

- 推薦35.1%

- 搜尋引擎0.0%

- 直接訪問64.9%

相關網站

AI Grammar Checker 快速識別語法錯誤、拼寫錯誤和標點問題,並提供即時建議,幫助您更清晰和準確地寫作。

InstantMind AI 輕鬆地將文本、文件、PowerPoint 簡報、YouTube 影片、圖片和網頁瞬間轉換為動態思維導圖。它旨在幫助您理順思路並提升生產力。

使用AISheets.study,您可以在幾分鐘內快速生成引人入勝且可打印的AI工作表,適用於任何科目。節省時間和精力,同時創建滿足您需求的自定義工作表。今天就來試試我們的AI工作表製作工具吧!

發現一款免費的英語聽寫應用程式,提供有趣的 YouTube 練習。透過雙語字幕提升你的聽寫技巧,獲得即時反饋,並練習針對 CEFR 等級 A1–C2 的日常例行活動。

以自己的步調掌握任何主題,完全免費。體驗一段變革性的學習旅程,擁有專為您量身定制的個性化路徑和引人入勝的練習課程。

輕鬆提升您的口語技巧,使用 TalkTune,您首選的 AI 驅動面試教練。無論您是在準備工作面試還是希望增強您的溝通能力,TalkTune 都會在每一步為您提供指導。

Trainn 是專為 SaaS 企業設計的客戶教育平台。它幫助您提升產品採用率、簡化入門流程並增強客戶留存率。使用 Trainn,小型和中型企業可以輕鬆地為其客戶提供一致的教育和培訓計劃,並且能夠大規模實施。

探索各種主題,收集相關作品,並生成有價值的見解——所有這些都在一個統一的研究工作空間中,專為簡化科學發現而設計。