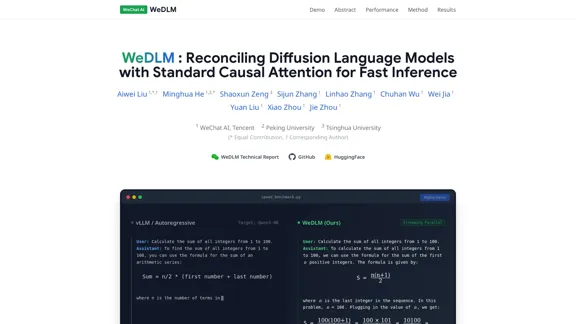

WeDLMは、拡散言語モデル(DLLMs)と標準的な因果注意メカニズムを調和させ、高速推論を実現する最先端のフレームワークです。これは、並列デコーディングを可能にしながら高品質な出力を維持することで、従来の自己回帰生成の限界に対処します。このフレームワークは、言語モデルの効率を向上させるように設計されており、数学的推論やコード生成など、さまざまなアプリケーションに適しています。

WeDLM - 標準的な因果注意と統合した拡散言語モデルによる高速推論の実現

WeDLM 紹介

WeDLM 機能

-

因果拡散フレームワーク

WeDLMは、完全に因果注意の下で動作する拡散デコーディングフレームワークを利用しています。この設計により、事前学習された自己回帰チェックポイントからのシームレスな初期化が可能になり、プレフィックスキャッシングとの互換性が保証されます。

-

プレフィックスキャッシュ互換性

モデルの予測トークンは即座にキャッシュされるため、次の位置を待つことなくコンテキストを効率的に再利用できます。この機能は推論の速度を向上させます。

-

ストリーミング並列デコーディング

WeDLMは、デコーディングのための動的スライディングウィンドウを導入しており、ブロック単位の手法に典型的な停止と待機の動作を排除します。このアプローチは、高いGPU利用率を維持し、生成プロセスを加速します。

-

パフォーマンスの改善

WeDLMは、複雑な推論タスクで最大3倍、低エントロピー生成シナリオで最大10倍の速度向上を実現し、最適化された自己回帰エンジンと比較して出力の品質を保持します。

-

包括的な能力

このフレームワークは、数学、コーディング、一般知識タスクを含むさまざまなベンチマークで既存のモデルの能力に匹敵するか、それを上回ります。

WeDLM どのように使用しますか?

- WeDLMフレームワークを理解するために、その技術報告書をレビューして、方法論を包括的に把握してください。

- 様々なベンチマークでのパフォーマンスを測るために、異なるタスクでモデルを試してみてください。

- キャッシング機能を効果的に活用して、アプリケーションの速度を向上させてください。

- 動的スライディングウィンドウアプローチを探求して、推論プロセスを最適化してください。

WeDLM よくある質問

WeDLMとは何ですか?

WeDLMは、言語モデルの推論の速度と効率を改善するために標準的な因果注意メカニズムを統合した拡散デコーディングフレームワークです。

WeDLMはどのようにして高速推論を実現しますか?

因果注意とストリーミング並列デコーディング戦略を採用することで、WeDLMはトークンの同時生成を可能にし、従来の自己回帰モデルと比較してレイテンシを大幅に削減します。

WeDLMを使用する主な利点は何ですか?

WeDLMは、速度の向上、プレフィックスキャッシュ互換性を提供し、さまざまなタスクで高品質な出力を維持するため、言語モデルアプリケーションにとって多用途なツールです。

WeDLMは他の言語モデルとどのように比較されますか?

WeDLMは、特に複雑な推論や低エントロピータスクにおいて、生成されたコンテンツの品質を保持しながら、速度の面で最適化された自己回帰エンジンを上回ります。

WeDLM 価格

価格データはまだ利用できません。公式ウェブサイトで確認してください。

WeDLM 評価

- WeDLMは、高品質な出力を生成しながら推論時間を大幅に短縮する印象的な能力を示しており、開発者や研究者にとって貴重なツールです。

- 因果注意と拡散モデルの統合は、パフォーマンスと効率を向上させる注目すべき革新です。

- ただし、モデルの複雑さにより、ユーザーはその能力を最大限に活用するために、拡散プロセスと因果注意メカニズムの両方についてしっかりとした理解が必要かもしれません。

- 全体として、WeDLMは言語モデル技術の重要な進歩を表していますが、新規ユーザーのためのよりユーザーフレンドリーなドキュメントやチュートリアルがあれば、アクセスしやすさが向上するでしょう。

WeDLM 最新のトラフィック情報

月間訪問数

直帰率

訪問あたりのページ数

サイト滞在時間(s)

グローバルランキング

国別ランキング

最近の訪問数

トラフィックソース

- ソーシャルメディア0.0%

- 有料リファラル0.0%

- メール0.0%

- リファラル35.1%

- 検索エンジン0.0%

- ダイレクト64.9%

関連ウェブサイト

TeachQuillは、アメリカの教育者のためのオールインワンプラットフォームです。コモンコアおよびNGSS基準に沿ったレッスンプラン、IEP目標、クイズ、ワークシートを生成します。

中国語のテキストを写真に撮るだけで、ワンタップで単語を調べたり、Ankiスタイルのフラッシュカードを作成したり、AIに質問したりできます。とても簡単で便利です!

私たちの無料の性格テストとスタイル分析であなたの本当の自分を発見してください。16タイプ指標、ビッグファイブ、エニアグラム、そしてカラー分析に飛び込み、すべてがTalkToSoul.comのAIインサイトによって強化されています。

PAiをダウンロードして、あなたの頼れるAI宿題アシスタントにしましょう。質問をキャッチし、瞬時に回答を受け取り、学業を成功させるためのパーソナライズされた学習サポートを楽しんでください!

Warm Talesで魅力的な短いおやすみ前の物語を探求してください。私たちの厳選されたコレクションは、子供たちの想像力をかき立て、貴重な家族の絆の瞬間を育みます。

ニューヨークに拠点を置くPaper Digestは、何千もの大学や企業のユーザーが読む、書く、答えを見つけるなどの支援を行います。

hyperPadを使えば、iPad上で簡単にゲームを作成・公開できます。コードを書く必要は一切ありません。直感的なドラッグ&ドロップインターフェースを使って、ゲームのロジックをスムーズに設計できます。さらに、準備が整ったら、作成した作品を直接App Storeにエクスポートできます。さあ、ゲーム開発の旅を始めましょう!

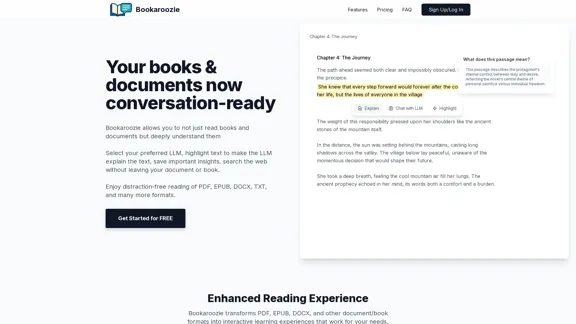

Bookaroozie - PDF、EPUB、DOCXなどのインタラクティブAIドキュメント&ブックリーダー

Bookaroozie - PDF、EPUB、DOCXなどのインタラクティブAIドキュメント&ブックリーダーBookaroozieで読書体験を向上させましょう。これは、読書中にAIと会話を楽しむことができるインタラクティブなドキュメントおよびブックリーダーです。サブスクリプション不要の一回限りの支払いでお楽しみいただけます。